📝 从困惑到清晰:归一化技术的适用场景全解析

在算法开发的日常工作中,你是否也有过这样的纠结: 训练模型前到底要不要做归一化?为什么有时候做了效果反而变差?不同的归一化方法到底该怎么选?

这些问题的核心,其实是没搞清楚归一化技术的本质和适用边界。今天我们就从原理出发,结合实际场景,把这个问题彻底讲透。

🧮 归一化的本质:让特征站在同一起跑线

归一化的核心目标是消除不同特征之间的量纲差异,把特征值映射到统一的区间(比如[0,1]或[-1,1]),或者转换成均值为0、方差为1的标准正态分布。

这么做的好处有三个:

- 加速模型收敛:避免量纲大的特征在梯度下降中占据主导地位

- 提升模型精度:让模型更公平地学习每个特征的重要性

- 避免数值问题:防止因为特征值差距过大导致的数值溢出

✅ 这些场景,一定要用归一化

🖥️ 基于梯度下降的模型

这类模型对特征的量纲非常敏感,必须做归一化:

- 神经网络(CNN、RNN、Transformer等):激活函数(如Sigmoid、Tanh)对输入范围很敏感,归一化能让梯度更稳定

- 线性模型(线性回归、逻辑回归):保证每个特征的系数具有可比性

- 支持向量机(SVM):基于距离计算的模型,量纲差异会直接影响分类边界

- K近邻(KNN):同样基于距离计算,量纲不同会让大数值特征主导距离计算

📊 需要特征可比性的场景

当你需要比较不同特征的重要性,或者进行特征选择时:

- 特征工程:比如用互信息、方差膨胀因子分析特征时,归一化能保证结果的公平性

- 可视化分析:绘制散点图、热力图时,归一化能让不同特征的分布趋势更直观

🔄 迭代优化的算法

涉及到距离计算或梯度更新的迭代算法:

- K-Means聚类:聚类结果会被大数值特征主导

- 主成分分析(PCA):PCA的方差最大化目标会被大数值特征影响,归一化后才能得到正确的主成分

❌ 这些场景,别用归一化

🎲 树模型类算法

基于树分裂的模型对特征量纲不敏感,归一化不会带来明显提升:

- 决策树:分裂时只看特征的相对大小,不关心绝对值

- 随机森林:集成了多个决策树,同样不受量纲影响

- XGBoost、LightGBM、CatBoost:这类进阶树模型自带特征重要性计算,归一化不会改变模型性能

📈 保持原始物理意义的场景

当特征的绝对数值具有实际业务含义时:

- 金融风控:用户的贷款金额、收入水平等特征的绝对值直接反映其还款能力

- 工业检测:温度、压力等传感器数据的绝对值代表实际物理状态

- 医疗诊断:血液指标的绝对值(如血糖浓度、白细胞数量)是诊断的直接依据

🎯 稀疏特征场景

对于高维稀疏的特征(如One-Hot编码后的类别特征):

- 归一化会破坏稀疏性,增加计算量

- 这类特征本身已经是0-1分布,不需要再做处理

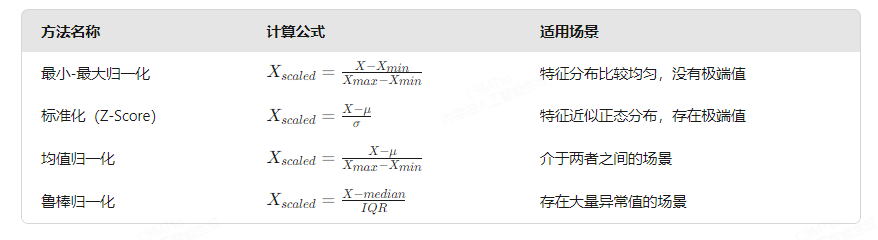

🛠️ 不同归一化方法的选择指南

📝 实战经验总结

- 先验证,后选择:在实际项目中,最好的方法是做对比实验,分别训练归一化和不归一化的模型,看哪个效果更好

- 不要盲目跟风:看到别人用了归一化就跟着用,要理解背后的原理

- 特殊情况特殊处理:对于混合类型的特征(比如既有连续特征又有类别特征),只对连续特征做归一化

- 注意数据泄露:归一化的统计量(均值、方差、最大最小值)必须只用训练集计算,不能用测试集的数据